Realtà aumentata - Augmented reality

La realtà aumentata ( AR ) è un'esperienza interattiva di un ambiente del mondo reale in cui gli oggetti che risiedono nel mondo reale sono migliorati da informazioni percettive generate al computer, a volte attraverso più modalità sensoriali , tra cui visiva , uditiva , tattile , somatosensoriale e olfattiva . L'AR può essere definito come un sistema che incorpora tre caratteristiche di base: una combinazione di mondi reali e virtuali, interazione in tempo reale e registrazione 3D accurata di oggetti virtuali e reali. L'informazione sensoriale sovrapposta può essere costruttiva (cioè additiva all'ambiente naturale) o distruttiva (cioè mascherante dell'ambiente naturale). Questa esperienza è perfettamente intrecciata con il mondo fisico in modo tale da essere percepita come un aspetto immersivo dell'ambiente reale. In questo modo, la realtà aumentata altera la percezione in corso di un ambiente del mondo reale, mentre la realtà virtuale sostituisce completamente l'ambiente del mondo reale dell'utente con uno simulato. La realtà aumentata è legata a due termini in gran parte sinonimi: realtà mista e realtà mediata dal computer .

Il valore primario della realtà aumentata è il modo in cui componenti del mondo digitale si fondono nella percezione di una persona del mondo reale, non come una semplice visualizzazione di dati, ma attraverso l'integrazione di sensazioni immersive, che sono percepite come parti naturali di un ambiente. I primi sistemi AR funzionali che fornivano esperienze immersive di realtà mista per gli utenti sono stati inventati nei primi anni '90, a partire dal sistema Virtual Fixtures sviluppato presso l' Armstrong Laboratory dell'aeronautica americana nel 1992. Le esperienze di realtà aumentata commerciale sono state introdotte per la prima volta nelle attività di intrattenimento e gioco. Successivamente, le applicazioni di realtà aumentata hanno abbracciato settori commerciali come l'istruzione, le comunicazioni, la medicina e l'intrattenimento. Nell'istruzione, è possibile accedere ai contenuti tramite la scansione o la visualizzazione di un'immagine con un dispositivo mobile o utilizzando tecniche AR senza marcatori.

La realtà aumentata viene utilizzata per migliorare ambienti o situazioni naturali e offrire esperienze percettivamente arricchite. Con l'aiuto di tecnologie AR avanzate (ad es. aggiunta di visione artificiale , incorporamento di fotocamere AR nelle applicazioni per smartphone e riconoscimento di oggetti ) le informazioni sul mondo reale circostante dell'utente diventano interattive e manipolate digitalmente. Le informazioni sull'ambiente e sui suoi oggetti sono sovrapposte al mondo reale. Queste informazioni possono essere virtuali. La Realtà Aumentata è qualsiasi esperienza che è artificiale e che si aggiunge alla realtà già esistente. o reale, ad esempio vedere altre informazioni reali rilevate o misurate come le onde radio elettromagnetiche sovrapposte in esatto allineamento con dove si trovano effettivamente nello spazio. La realtà aumentata ha anche un grande potenziale nella raccolta e nella condivisione della conoscenza tacita. Le tecniche di incremento sono tipicamente eseguite in tempo reale e in contesti semantici con elementi ambientali. Le informazioni percettive coinvolgenti sono talvolta combinate con informazioni supplementari come i punteggi su un feed video in diretta di un evento sportivo. Questo combina i vantaggi della tecnologia della realtà aumentata e della tecnologia di visualizzazione heads up (HUD).

Confronto con la realtà virtuale

Nella realtà virtuale (VR), la percezione della realtà da parte degli utenti è completamente basata sull'informazione virtuale. Nella realtà aumentata (AR) all'utente vengono fornite informazioni aggiuntive generate dal computer all'interno dei dati raccolti dalla vita reale che migliorano la sua percezione della realtà. Ad esempio, in architettura, la realtà virtuale può essere utilizzata per creare una simulazione di passaggio dell'interno di un nuovo edificio; e AR possono essere utilizzati per mostrare le strutture e i sistemi di un edificio sovrapposti a una vista reale. Un altro esempio è attraverso l'uso di applicazioni di utilità. Alcune applicazioni AR, come Augment , consentono agli utenti di applicare oggetti digitali in ambienti reali, consentendo alle aziende di utilizzare dispositivi di realtà aumentata come un modo per visualizzare in anteprima i propri prodotti nel mondo reale. Allo stesso modo, può anche essere utilizzato per dimostrare come potrebbero apparire i prodotti in un ambiente per i clienti, come dimostrato da aziende come Mountain Equipment Co-op o Lowe's che utilizzano la realtà aumentata per consentire ai clienti di visualizzare in anteprima come potrebbero apparire i loro prodotti a casa attraverso l'utilizzo di modelli 3D.

La realtà aumentata (AR) differisce dalla realtà virtuale (VR) nel senso che in AR parte dell'ambiente circostante è in realtà "reale" e aggiunge semplicemente strati di oggetti virtuali all'ambiente reale. In VR, invece, l'ambiente circostante è completamente virtuale. Una dimostrazione di come l'AR sovrappone gli oggetti al mondo reale può essere vista con i giochi di realtà aumentata. WallaMe è un'applicazione di gioco in realtà aumentata che consente agli utenti di nascondere i messaggi in ambienti reali, utilizzando la tecnologia di geolocalizzazione per consentire agli utenti di nascondere i messaggi ovunque nel mondo. Tali applicazioni hanno molti usi nel mondo, incluso nell'attivismo e nell'espressione artistica.

Tecnologia

Hardware

I componenti hardware per la realtà aumentata sono: un processore, display, sensori e dispositivi di input. I moderni dispositivi di elaborazione mobile come smartphone e tablet contengono questi elementi, che spesso includono una fotocamera e sensori di sistemi microelettromeccanici ( MEMS ) come un accelerometro , GPS e una bussola a stato solido , rendendoli piattaforme AR adatte. Ci sono due tecnologie utilizzate nella realtà aumentata: guide d'onda diffrattive e guide d'onda riflettenti.

Schermo

Varie tecnologie sono utilizzate nel rendering della realtà aumentata, inclusi sistemi di proiezione ottica , monitor , dispositivi portatili e sistemi di visualizzazione, che vengono indossati sul corpo umano.

Un display montato sulla testa (HMD) è un dispositivo di visualizzazione indossato sulla fronte, come un'imbracatura o un elmetto . Gli HMD posizionano le immagini sia del mondo fisico che degli oggetti virtuali nel campo visivo dell'utente. I moderni HMD spesso utilizzano sensori per il monitoraggio a sei gradi di libertà che consentono al sistema di allineare le informazioni virtuali al mondo fisico e di adattarsi di conseguenza ai movimenti della testa dell'utente. Gli HMD possono fornire agli utenti VR esperienze mobili e collaborative. Fornitori specifici, come uSens e Gestigon , includono controlli gestuali per una full immersion virtuale .

Occhiali

I display AR possono essere renderizzati su dispositivi simili agli occhiali. Le versioni includono occhiali che utilizzano telecamere per intercettare la visione del mondo reale e visualizzare nuovamente la sua vista aumentata attraverso gli oculari e i dispositivi in cui le immagini AR vengono proiettate o riflesse dalle superfici delle lenti degli occhiali.

HUD

Un display head-up (HUD) è un display trasparente che presenta i dati senza richiedere agli utenti di distogliere lo sguardo dai loro soliti punti di vista. Una tecnologia precursore della realtà aumentata, i display heads-up sono stati sviluppati per la prima volta per i piloti negli anni '50, proiettando semplici dati di volo nella loro linea di vista, consentendo loro di tenere la testa alta e non guardare gli strumenti. I dispositivi di realtà aumentata near-eye possono essere utilizzati come display head-up portatili in quanto possono mostrare dati, informazioni e immagini mentre l'utente guarda il mondo reale. Molte definizioni di realtà aumentata la definiscono solo come sovrapposizione delle informazioni. Questo è fondamentalmente ciò che fa un display head-up; tuttavia, in pratica, ci si aspetta che la realtà aumentata includa la registrazione e il monitoraggio tra le percezioni, le sensazioni, le informazioni, i dati e le immagini sovrapposte e una parte del mondo reale.

Lenti a contatto

Le lenti a contatto che visualizzano immagini AR sono in fase di sviluppo. Queste lenti a contatto bioniche potrebbero contenere gli elementi per la visualizzazione incorporati nell'obiettivo, inclusi circuiti integrati, LED e un'antenna per la comunicazione wireless. Il primo display per lenti a contatto è stato brevettato nel 1999 da Steve Mann e doveva funzionare in combinazione con gli occhiali AR, ma il progetto è stato abbandonato, quindi 11 anni dopo, nel 2010-2011. Un'altra versione di lenti a contatto, in sviluppo per le forze armate statunitensi, è progettata per funzionare con gli occhiali AR, consentendo ai soldati di concentrarsi contemporaneamente su immagini AR ravvicinate sugli occhiali e su oggetti del mondo reale distanti.

Al CES 2013, una società chiamata Innovega ha anche presentato lenti a contatto simili che dovevano essere combinate con occhiali AR per funzionare.

Il cortometraggio futuristico Sight presenta dispositivi di realtà aumentata simili a lenti a contatto.

Molti scienziati hanno lavorato su lenti a contatto capaci di diverse prodezze tecnologiche. Un brevetto depositato da Samsung descrive una lente a contatto AR, che, una volta completata, includerà una fotocamera integrata sull'obiettivo stesso. Il design ha lo scopo di controllare la sua interfaccia battendo le palpebre. È anche pensato per essere collegato allo smartphone dell'utente per rivedere i filmati e controllarli separatamente. In caso di successo, l'obiettivo sarebbe dotato di una fotocamera o di un sensore al suo interno. Si dice che potrebbe essere qualsiasi cosa, da un sensore di luce, a un sensore di temperatura.

Il primo prototipo funzionante svelato pubblicamente di una lente a contatto AR che non richiede l'uso di occhiali insieme è stato sviluppato da Mojo Vision e annunciato e mostrato al CES 2020.

Display retinico virtuale

Un display retinico virtuale (VRD) è un dispositivo di visualizzazione personale in fase di sviluppo presso lo Human Interface Technology Laboratory dell'Università di Washington sotto la direzione del Dr. Thomas A. Furness III. Con questa tecnologia, un display viene scansionato direttamente sulla retina dell'occhio dell'osservatore. Ciò si traduce in immagini luminose con alta risoluzione e contrasto elevato. Lo spettatore vede quello che sembra essere un display convenzionale fluttuare nello spazio.

Sono stati effettuati diversi test per analizzare la sicurezza del VRD. In un test, i pazienti con perdita parziale della vista, affetti da degenerazione maculare (una malattia che degenera la retina) o cheratocono, sono stati selezionati per visualizzare le immagini utilizzando la tecnologia. Nel gruppo con degenerazione maculare, cinque su otto soggetti preferivano le immagini VRD al tubo a raggi catodici (CRT) o alle immagini su carta e pensavano che fossero migliori e più luminose e fossero in grado di vedere livelli di risoluzione uguali o migliori. I pazienti con cheratocono potrebbero tutti risolvere linee più piccole in diversi test di linea utilizzando il VRD anziché la propria correzione. Hanno anche scoperto che le immagini VRD sono più facili da visualizzare e più nitide. Come risultato di questi numerosi test, il display retinico virtuale è considerato una tecnologia sicura.

Il display retinico virtuale crea immagini che possono essere viste alla luce del giorno ambientale e alla luce ambientale della stanza. Il VRD è considerato un candidato preferito da utilizzare in un display chirurgico grazie alla sua combinazione di alta risoluzione, contrasto e luminosità elevati. Ulteriori test mostrano un alto potenziale di utilizzo della VRD come tecnologia di visualizzazione per i pazienti con problemi di vista.

Eye Tap

L' EyeTap (noto anche come vetro di seconda generazione) cattura i raggi di luce che altrimenti passerebbero attraverso il centro della lente dell'occhio di chi lo indossa e sostituisce ogni raggio di luce reale con una luce sintetica controllata da computer.

Il vetro di quarta generazione (Laser EyeTap) è simile al VRD (cioè utilizza una sorgente di luce laser controllata da computer) tranne per il fatto che ha anche una profondità di messa a fuoco infinita e fa sì che l'occhio stesso, in effetti, funzioni sia come fotocamera e una visualizzazione tramite l'esatto allineamento con l'occhio e la risintesi (in luce laser) dei raggi di luce che entrano nell'occhio.

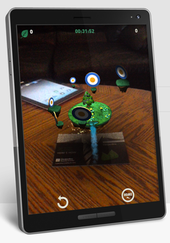

palmare

Un display palmare utilizza un piccolo display che si adatta alla mano dell'utente. Tutte le soluzioni AR portatili fino ad oggi optano per il video see-through. Inizialmente l'AR portatile utilizzava marcatori fiduciali , e successivamente unità GPS e sensori MEMS come bussole digitali e accelerometro- giroscopio a sei gradi di libertà . Oggi i tracker senza marcatori di localizzazione e mappatura simultanea (SLAM) come PTAM (tracciamento e mappatura paralleli) stanno iniziando a entrare in uso. Display portatile AR promette di essere il primo successo commerciale per le tecnologie AR. I due principali vantaggi dell'AR portatile sono la natura portatile dei dispositivi portatili e la natura onnipresente dei telefoni con fotocamera. Gli svantaggi sono i vincoli fisici dell'utente che deve tenere sempre il dispositivo portatile davanti a sé, nonché l'effetto di distorsione delle classiche fotocamere grandangolari dei telefoni cellulari rispetto al mondo reale visto attraverso l'occhio.

Giochi come Pokémon Go e Ingress utilizzano un'interfaccia Image Linked Map (ILM), in cui le posizioni georeferenziate approvate vengono visualizzate su una mappa stilizzata con cui l'utente può interagire.

Mappatura della proiezione

La mappatura della proiezione aumenta gli oggetti e le scene del mondo reale, senza l'uso di display speciali come monitor, display montati sulla testa o dispositivi portatili. La mappatura della proiezione utilizza proiettori digitali per visualizzare informazioni grafiche su oggetti fisici. La differenza chiave nella mappatura della proiezione è che il display è separato dagli utenti del sistema. Poiché i display non sono associati a ciascun utente, la mappatura della proiezione si adatta naturalmente a gruppi di utenti, consentendo una collaborazione collocata tra gli utenti.

Gli esempi includono lampade shader , proiettori mobili, tavoli virtuali e proiettori intelligenti. Le lampade Shader imitano e aumentano la realtà proiettando immagini su oggetti neutri. Ciò offre l'opportunità di migliorare l'aspetto dell'oggetto con i materiali di una semplice unità: proiettore, fotocamera e sensore.

Altre applicazioni includono proiezioni da tavolo e da parete. Un'innovazione, il tavolo virtuale esteso, separa il virtuale dal reale includendo specchi divisori di fascio fissati al soffitto con un'angolazione regolabile. Le vetrine virtuali, che utilizzano specchi divisori di fascio insieme a più display grafici, forniscono un mezzo interattivo per interagire contemporaneamente con il virtuale e il reale. Molte più implementazioni e configurazioni rendono il display della realtà aumentata spaziale un'alternativa interattiva sempre più attraente.

Un sistema di mappatura di proiezione può essere visualizzato su qualsiasi numero di superfici in un ambiente interno contemporaneamente. La mappatura della proiezione supporta sia una visualizzazione grafica che una sensazione tattile passiva per gli utenti finali. Gli utenti sono in grado di toccare oggetti fisici in un processo che fornisce una sensazione tattile passiva.

Monitoraggio

I moderni sistemi mobili di realtà aumentata utilizzano una o più delle seguenti tecnologie di rilevamento del movimento : fotocamere digitali e/o altri sensori ottici , accelerometri, GPS, giroscopi, bussole a stato solido, identificazione a radiofrequenza (RFID). Queste tecnologie offrono diversi livelli di accuratezza e precisione. Il più importante è la posizione e l'orientamento della testa dell'utente. Tracciare le mani dell'utente o un dispositivo di input portatile può fornire una tecnica di interazione 6DOF.

Rete

Le applicazioni mobili di realtà aumentata stanno guadagnando popolarità grazie all'ampia adozione di dispositivi mobili e soprattutto indossabili. Tuttavia, spesso si basano su algoritmi di visione artificiale ad alta intensità di calcolo con requisiti di latenza estremi. Per compensare la mancanza di potenza di calcolo, spesso si desidera scaricare l'elaborazione dei dati su una macchina lontana. L'offload di calcolo introduce nuovi vincoli nelle applicazioni, soprattutto in termini di latenza e larghezza di banda. Sebbene esistano numerosi protocolli di trasporto multimediale in tempo reale, è necessario anche il supporto dell'infrastruttura di rete.

Dispositivi di input

Le tecniche includono sistemi di riconoscimento vocale che traducono le parole pronunciate da un utente in istruzioni per computer e sistemi di riconoscimento dei gesti che interpretano i movimenti del corpo di un utente mediante rilevamento visivo o da sensori incorporati in un dispositivo periferico come una bacchetta magica, uno stilo, un puntatore, un guanto o altri indumenti per il corpo . I prodotti che stanno cercando di fungere da controller di cuffie AR includono Wave di Seebright Inc. e Nimble di Intugine Technologies.

Computer

Il computer analizza i dati visivi rilevati e altri dati per sintetizzare e posizionare gli aumenti. I computer sono responsabili della grafica che accompagna la realtà aumentata. La realtà aumentata utilizza un'immagine generata al computer che ha un effetto sorprendente sul modo in cui viene mostrato il mondo reale. Con il miglioramento della tecnologia e dei computer, la realtà aumentata porterà a un drastico cambiamento nella prospettiva del mondo reale. Secondo Time , in circa 15-20 anni si prevede che la realtà aumentata e la realtà virtuale diventeranno l'uso principale per le interazioni tra computer. I computer stanno migliorando a un ritmo molto veloce, portando a nuovi modi per migliorare altre tecnologie. Più i computer progrediranno, più la realtà aumentata diventerà più flessibile e più comune nella società. I computer sono il cuore della realtà aumentata. Il computer riceve i dati dai sensori che determinano la posizione relativa della superficie di un oggetto. Questo si traduce in un input per il computer che poi invia agli utenti aggiungendo qualcosa che altrimenti non sarebbe presente. Il computer comprende memoria e un processore. Il computer prende l'ambiente scansionato, quindi genera immagini o un video e lo inserisce nel ricevitore affinché l'osservatore possa vederlo. I segni fissi sulla superficie di un oggetto sono memorizzati nella memoria di un computer. Il computer si ritira anche dalla sua memoria per presentare realisticamente le immagini allo spettatore. Il miglior esempio di questo è il Pepsi Max AR Bus Shelter.

Proiettore

I proiettori possono essere utilizzati anche per visualizzare contenuti AR. Il proiettore può proiettare un oggetto virtuale su uno schermo di proiezione e lo spettatore può interagire con questo oggetto virtuale. Le superfici di proiezione possono essere molti oggetti come pareti o lastre di vetro.

Software e algoritmi

Una misura chiave dei sistemi AR è il modo in cui integrano realisticamente i potenziamenti con il mondo reale. Il software deve derivare le coordinate del mondo reale, indipendentemente dalla telecamera e dalle immagini della telecamera. Questo processo è chiamato registrazione dell'immagine e utilizza diversi metodi di visione artificiale , principalmente legati al monitoraggio video . Molti metodi di visione artificiale della realtà aumentata sono ereditati dall'odometria visiva . Un agogramma è un'immagine generata dal computer che viene utilizzata per creare AR. L'augografia è la scienza e la pratica del software per creare augogrammi per AR.

Di solito questi metodi consistono di due parti. La prima fase consiste nel rilevare i punti di interesse , i marker fiduciali o il flusso ottico nelle immagini della telecamera. Questo passaggio può utilizzare metodi di rilevamento delle caratteristiche come rilevamento degli angoli , rilevamento dei blob , rilevamento dei bordi o soglia e altri metodi di elaborazione delle immagini . La seconda fase ripristina un sistema di coordinate del mondo reale dai dati ottenuti nella prima fase. Alcuni metodi presuppongono che nella scena siano presenti oggetti con geometria nota (o marker fiduciali). In alcuni di questi casi la struttura 3D della scena dovrebbe essere calcolata in anticipo. Se una parte della scena è sconosciuta, la localizzazione e la mappatura simultanee (SLAM) possono mappare le posizioni relative. Se non sono disponibili informazioni sulla geometria della scena, viene utilizzata la struttura dei metodi di movimento come la regolazione del fascio . I metodi matematici utilizzati nella seconda fase includono: geometria proiettiva ( epipolare ), algebra geometrica , rappresentazione della rotazione con mappa esponenziale , filtri kalman e particellari , ottimizzazione non lineare , statistica robusta .

Nella realtà aumentata, viene fatta la distinzione tra due modalità distinte di tracciamento, note come marker e markerless . I marker sono segnali visivi che attivano la visualizzazione delle informazioni virtuali. È possibile utilizzare un pezzo di carta con alcune geometrie distinte. La telecamera riconosce le geometrie identificando punti specifici nel disegno. Il tracciamento senza marcatori, chiamato anche tracciamento istantaneo, non utilizza i marcatori. Invece, l'utente posiziona l'oggetto nella vista della telecamera preferibilmente su un piano orizzontale. Utilizza sensori nei dispositivi mobili per rilevare con precisione l'ambiente del mondo reale, come la posizione dei muri e dei punti di intersezione.

Augmented Reality Markup Language (ARML) è uno standard di dati sviluppato all'interno dell'Open Geospatial Consortium (OGC), che consiste nella grammatica Extensible Markup Language ( XML ) per descrivere la posizione e l'aspetto degli oggetti virtuali nella scena, nonché i collegamenti ECMAScript per consentire l'accesso dinamico alle proprietà degli oggetti virtuali.

Per consentire lo sviluppo rapido di applicazioni di realtà aumentata, sono emersi alcuni kit di sviluppo software (SDK).

Sviluppo

L'implementazione della realtà aumentata nei prodotti di consumo richiede di considerare il design delle applicazioni e i relativi vincoli della piattaforma tecnologica. Poiché i sistemi AR si basano molto sull'immersione dell'utente e sull'interazione tra l'utente e il sistema, il design può facilitare l'adozione della virtualità. Per la maggior parte dei sistemi di realtà aumentata, è possibile seguire una linea guida di progettazione simile. Di seguito sono elencate alcune considerazioni per la progettazione di applicazioni di realtà aumentata:

Progettazione ambientale/contestuale

Context Design si concentra sull'ambiente fisico dell'utente finale, sullo spazio spaziale e sull'accessibilità che possono svolgere un ruolo quando si utilizza il sistema AR. I progettisti devono essere consapevoli dei possibili scenari fisici in cui potrebbe trovarsi l'utente finale, ad esempio:

- Pubblico, in cui gli utenti usano tutto il loro corpo per interagire con il software

- Personale, in cui l'utente utilizza uno smartphone in uno spazio pubblico

- Intimo, in cui l'utente è seduto con un desktop e non si muove realmente

- Privato, in cui l'utente ha su un indossabile.

Valutando ogni scenario fisico, è possibile evitare potenziali rischi per la sicurezza e apportare modifiche per migliorare ulteriormente l'immersione dell'utente finale. I progettisti di UX dovranno definire i percorsi dell'utente per gli scenari fisici rilevanti e definire il modo in cui l'interfaccia reagisce a ciascuno di essi.

Soprattutto nei sistemi AR, è fondamentale considerare anche gli elementi spaziali e circostanti che modificano l'efficacia della tecnologia AR. Elementi ambientali come luci e suoni possono impedire al sensore del dispositivo AR di rilevare i dati necessari e rovinare l'immersione dell'utente finale.

Un altro aspetto della progettazione del contesto riguarda la progettazione delle funzionalità del sistema e la sua capacità di soddisfare le preferenze dell'utente. Sebbene gli strumenti di accessibilità siano comuni nella progettazione di applicazioni di base, è necessario fare alcune considerazioni durante la progettazione di prompt a tempo limitato (per prevenire operazioni involontarie), segnali audio e tempo di coinvolgimento complessivo. È importante notare che in alcune situazioni, la funzionalità dell'applicazione può ostacolare la capacità dell'utente. Ad esempio, le applicazioni utilizzate per la guida dovrebbero ridurre la quantità di interazione dell'utente e utilizzare invece segnali audio.

Design interattivo

Il design dell'interazione nella tecnologia della realtà aumentata è incentrato sul coinvolgimento dell'utente con il prodotto finale per migliorare l'esperienza e il divertimento complessivi dell'utente. Lo scopo dell'interaction design è evitare di alienare o confondere l'utente organizzando le informazioni presentate. Poiché l'interazione dell'utente si basa sull'input dell'utente, i progettisti devono rendere i controlli di sistema più facili da capire e accessibili. Una tecnica comune per migliorare l'usabilità delle applicazioni di realtà aumentata consiste nell'individuare le aree a cui si accede di frequente nel display touch del dispositivo e progettare l'applicazione in modo che corrisponda a tali aree di controllo. È anche importante strutturare le mappe di viaggio dell'utente e il flusso di informazioni presentate che riducono il carico cognitivo complessivo del sistema e migliorano notevolmente la curva di apprendimento dell'applicazione.

Nella progettazione dell'interazione, è importante che gli sviluppatori utilizzino la tecnologia della realtà aumentata che integri la funzione o lo scopo del sistema. Ad esempio, l'utilizzo di entusiasmanti filtri AR e il design della piattaforma di condivisione unica in Snapchat consente agli utenti di aumentare le loro interazioni sociali in-app. In altre applicazioni che richiedono agli utenti di comprendere il focus e l'intento, i progettisti possono utilizzare un reticolo o un raycast dal dispositivo. Inoltre, gli sviluppatori di realtà aumentata possono ritenere opportuno che gli elementi digitali si ridimensionino o reagiscano alla direzione della telecamera e al contesto degli oggetti che possono essere rilevati.

La tecnologia della realtà aumentata permette di sfruttare l'introduzione dello spazio 3D . Ciò significa che un utente può potenzialmente accedere a più copie di interfacce 2D all'interno di una singola applicazione AR.

Design visivo

In generale, il design visivo è l'aspetto dell'applicazione in via di sviluppo che coinvolge l'utente. Per migliorare gli elementi dell'interfaccia grafica e l'interazione dell'utente, gli sviluppatori possono utilizzare segnali visivi per informare l'utente con quali elementi dell'interfaccia utente sono progettati per interagire e come interagire con essi. Poiché la navigazione in un'applicazione AR può sembrare difficile e frustrante, il design dei segnali visivi può far sembrare le interazioni più naturali.

In alcune applicazioni di realtà aumentata che utilizzano un dispositivo 2D come superficie interattiva, l'ambiente di controllo 2D non si traduce bene nello spazio 3D, rendendo gli utenti riluttanti a esplorare l'ambiente circostante. Per risolvere questo problema, i progettisti dovrebbero applicare segnali visivi per assistere e incoraggiare gli utenti a esplorare l'ambiente circostante.

È importante notare i due oggetti principali in AR quando si sviluppano applicazioni VR: oggetti volumetrici 3D che vengono manipolati e interagiscono realisticamente con luci e ombre; e immagini multimediali animate come immagini e video che sono per lo più media 2D tradizionali resi in un nuovo contesto per la realtà aumentata. Quando gli oggetti virtuali vengono proiettati su un ambiente reale, è difficile per i progettisti di applicazioni di realtà aumentata garantire un'integrazione perfetta rispetto all'ambiente reale, in particolare con gli oggetti 2D. Pertanto, i progettisti possono aggiungere peso agli oggetti, utilizzare mappe di profondità e scegliere diverse proprietà dei materiali che evidenzino la presenza dell'oggetto nel mondo reale. Un altro design visivo che può essere applicato è l'utilizzo di diverse tecniche di illuminazione o la proiezione di ombre per migliorare il giudizio complessivo sulla profondità. Ad esempio, una tecnica di illuminazione comune consiste semplicemente nel posizionare una fonte di luce in alto a ore 12, per creare ombre su oggetti virtuali.

Possibili applicazioni

La realtà aumentata è stata esplorata per molte applicazioni, dai giochi e dall'intrattenimento alla medicina, all'istruzione e al business. Esempi di aree applicative descritte di seguito includono archeologia, architettura, commercio e istruzione. Alcuni dei primi esempi citati includono la realtà aumentata utilizzata per supportare la chirurgia fornendo sovrapposizioni virtuali per guidare i medici, ai contenuti AR per l'astronomia e la saldatura.

Archeologia

AR è stato utilizzato per aiutare la ricerca archeologica . Aumentando le caratteristiche archeologiche nel paesaggio moderno, l'AR consente agli archeologi di formulare possibili configurazioni del sito da strutture esistenti. I modelli generati al computer di rovine, edifici, paesaggi o persino persone antiche sono stati riciclati nelle prime applicazioni AR archeologiche. Ad esempio, l'implementazione di un sistema come VITA (Visual Interaction Tool for Archaeology) consentirà agli utenti di immaginare e analizzare i risultati di scavo istantanei senza uscire di casa. Ciascun utente può collaborare "navigando, cercando e visualizzando i dati" reciprocamente. Hrvoje Benko, ricercatore nel dipartimento di informatica della Columbia University , sottolinea che questi particolari sistemi e altri simili possono fornire "immagini panoramiche 3D e modelli 3D del sito stesso in diverse fasi di scavo" mentre organizzano gran parte dei dati in modo collaborativo e facile da usare. I sistemi AR collaborativi forniscono interazioni multimodali che combinano il mondo reale con immagini virtuali di entrambi gli ambienti.

Architettura

L'AR può aiutare a visualizzare i progetti di costruzione. Le immagini generate al computer di una struttura possono essere sovrapposte a una vista locale reale di una proprietà prima che l'edificio fisico venga costruito lì; questo è stato dimostrato pubblicamente da Trimble Navigation nel 2004. L'AR può anche essere impiegato all'interno dello spazio di lavoro di un architetto, per il rendering di visualizzazioni 3D animate dei loro disegni 2D. La vista dell'architettura può essere migliorata con le applicazioni AR, consentendo agli utenti che guardano l'esterno di un edificio di vedere virtualmente attraverso le sue pareti, visualizzando i suoi oggetti interni e il layout.

Grazie ai continui miglioramenti della precisione del GPS , le aziende sono in grado di utilizzare la realtà aumentata per visualizzare modelli georeferenziati di cantieri, strutture sotterranee, cavi e tubi utilizzando dispositivi mobili. La realtà aumentata viene applicata per presentare nuovi progetti, risolvere sfide di costruzione in loco e migliorare i materiali promozionali. Gli esempi includono il Daqri Smart Helmet, un casco basato su Android utilizzato per creare la realtà aumentata per il lavoratore industriale, incluse istruzioni visive, avvisi in tempo reale e mappatura 3D.

Dopo il terremoto di Christchurch , l'Università di Canterbury ha rilasciato CityViewAR, che ha permesso agli urbanisti e agli ingegneri di visualizzare gli edifici che erano stati distrutti. Ciò non solo fornì ai progettisti gli strumenti per fare riferimento al precedente paesaggio urbano , ma servì anche come promemoria dell'entità della devastazione risultante, poiché interi edifici erano stati demoliti.

Progettazione e pianificazione urbana

I sistemi AR vengono utilizzati come strumenti collaborativi per la progettazione e la pianificazione nell'ambiente costruito. Ad esempio, l'AR può essere utilizzato per creare mappe di realtà aumentata, edifici e feed di dati proiettati su tavoli per la visualizzazione collaborativa da parte di professionisti dell'ambiente costruito. L'AR per esterni promette che i progetti e i piani possono essere sovrapposti al mondo reale, ridefinendo il mandato di queste professioni per portare la progettazione in situ nel loro processo. Le opzioni di progettazione possono essere articolate in loco e apparire più vicine alla realtà rispetto ai tradizionali meccanismi desktop come mappe 2D e modelli 3D.

Istruzione STEM

Negli ambienti educativi, l'AR è stato utilizzato per integrare un curriculum standard. Testo, grafica, video e audio possono essere sovrapposti nell'ambiente in tempo reale di uno studente. Libri di testo, flashcard e altro materiale di lettura educativo possono contenere "marcatori" o trigger incorporati che, quando scansionati da un dispositivo AR, hanno prodotto informazioni supplementari per lo studente rese in un formato multimediale. Il 2015 Virtual, Augmented and Mixed Reality: 7th International Conference ha citato Google Glass come un esempio di realtà aumentata che può sostituire l'aula fisica. Innanzitutto, le tecnologie AR aiutano gli studenti a impegnarsi in un'esplorazione autentica nel mondo reale e oggetti virtuali come testi, video e immagini sono elementi supplementari per gli studenti per condurre indagini sull'ambiente circostante.

Man mano che l'AR si evolve, gli studenti possono partecipare in modo interattivo e interagire con la conoscenza in modo più autentico. Invece di rimanere destinatari passivi, gli studenti possono diventare studenti attivi, in grado di interagire con il loro ambiente di apprendimento. Le simulazioni generate al computer di eventi storici consentono agli studenti di esplorare e apprendere i dettagli di ciascuna area significativa del sito dell'evento.

Nell'istruzione superiore, Construct3D, un sistema Studierstube, consente agli studenti di apprendere concetti di ingegneria meccanica, matematica o geometria. Le app AR di chimica consentono agli studenti di visualizzare e interagire con la struttura spaziale di una molecola utilizzando un oggetto marcatore tenuto in mano. Altri hanno utilizzato HP Reveal, un'app gratuita, per creare notecard AR per lo studio dei meccanismi di chimica organica o per creare dimostrazioni virtuali su come utilizzare la strumentazione di laboratorio. Gli studenti di anatomia possono visualizzare diversi sistemi del corpo umano in tre dimensioni. È stato dimostrato che l'uso dell'AR come strumento per apprendere le strutture anatomiche aumenta la conoscenza dello studente e fornisce vantaggi intrinseci, come un maggiore coinvolgimento e immersione dello studente.

Produzione industriale

L'AR viene utilizzato per sostituire i manuali cartacei con istruzioni digitali che vengono sovrapposte al campo visivo dell'operatore di produzione, riducendo lo sforzo mentale necessario per operare. L'AR rende efficiente la manutenzione della macchina perché offre agli operatori l'accesso diretto alla cronologia di manutenzione di una macchina. I manuali virtuali aiutano i produttori ad adattarsi ai progetti di prodotti in rapida evoluzione, poiché le istruzioni digitali sono più facilmente modificabili e distribuite rispetto ai manuali fisici.

Le istruzioni digitali aumentano la sicurezza dell'operatore eliminando la necessità per gli operatori di guardare uno schermo o un manuale lontano dall'area di lavoro, che può essere pericoloso. Invece, le istruzioni sono sovrapposte all'area di lavoro. L'uso dell'AR può aumentare la sensazione di sicurezza degli operatori quando lavorano vicino a macchinari industriali ad alto carico, fornendo agli operatori informazioni aggiuntive sullo stato di una macchina e sulle funzioni di sicurezza, nonché sulle aree pericolose dell'area di lavoro.

Commercio

L'AR viene utilizzato per integrare il marketing di stampa e video. Il materiale di marketing stampato può essere progettato con determinate immagini "trigger" che, se scansionate da un dispositivo abilitato per AR utilizzando il riconoscimento delle immagini, attivano una versione video del materiale promozionale. Una delle principali differenze tra la realtà aumentata e il riconoscimento diretto delle immagini è che è possibile sovrapporre più media contemporaneamente nella schermata di visualizzazione, come i pulsanti di condivisione dei social media, il video in-page, persino l'audio e gli oggetti 3D. Le pubblicazioni tradizionali di sola stampa utilizzano la realtà aumentata per connettere diversi tipi di media.

L'AR può migliorare le anteprime dei prodotti, ad esempio consentendo a un cliente di visualizzare cosa c'è all'interno della confezione di un prodotto senza aprirlo. L'AR può essere utilizzato anche come ausilio nella selezione dei prodotti da un catalogo o tramite un chiosco. Le immagini scansionate dei prodotti possono attivare visualizzazioni di contenuti aggiuntivi come opzioni di personalizzazione e immagini aggiuntive del prodotto nel suo utilizzo.

Nel 2010 sono stati sviluppati spogliatoi virtuali per l'e-commerce.

Nel 2012, una zecca ha utilizzato tecniche AR per commercializzare una moneta commemorativa per Aruba. La moneta stessa è stata utilizzata come trigger AR e, se tenuta di fronte a un dispositivo abilitato per AR, ha rivelato ulteriori oggetti e livelli di informazioni che non erano visibili senza il dispositivo.

Nel 2018, Apple ha annunciato il supporto per i file AR USDZ per iPhone e iPad con iOS12. Apple ha creato una galleria AR QuickLook che consente alle masse di sperimentare la realtà aumentata sul proprio dispositivo Apple.

Nel 2018, Shopify , la società di e-commerce canadese, ha annunciato l'integrazione di ARkit2. I loro commercianti sono in grado di utilizzare gli strumenti per caricare modelli 3D dei loro prodotti. Gli utenti potranno toccare i prodotti all'interno di Safari per visualizzarli nei loro ambienti reali.

Nel 2018, Twinkl ha rilasciato un'applicazione di classe AR gratuita. Gli alunni possono vedere come appariva York oltre 1.900 anni fa. Twinkl ha lanciato il primo gioco AR multiplayer in assoluto, Little Red e ha oltre 100 modelli educativi AR gratuiti.

La realtà aumentata sta diventando sempre più utilizzata per la pubblicità online. I rivenditori offrono la possibilità di caricare un'immagine sul proprio sito Web e "provare" vari vestiti che sono sovrapposti all'immagine. Inoltre, aziende come Bodymetrics installano cabine spogliatoio nei grandi magazzini che offrono la scansione di tutto il corpo . Queste cabine restituiscono un modello 3D dell'utente, consentendo ai consumatori di visualizzare abiti diversi su se stessi senza la necessità di cambiarsi fisicamente i vestiti. Ad esempio, JC Penney e Bloomingdale utilizzano " camerini virtuali " che consentono ai clienti di vedere se stessi in abiti senza provarli. Un altro negozio che utilizza l'AR per commercializzare abbigliamento ai propri clienti è Neiman Marcus . Neiman Marcus offre ai consumatori la possibilità di vedere i loro abiti in una vista a 360 gradi con il loro "specchio della memoria". Anche negozi di cosmetici come L'Oreal , Sephora , Charlotte Tilbury e Rimmel hanno app che utilizzano AR. Queste app consentono ai consumatori di vedere come apparirà il trucco su di loro. Secondo Greg Jones, direttore di AR e VR di Google, la realtà aumentata "ricollegherà la vendita al dettaglio fisica e digitale".

La tecnologia AR è utilizzata anche da rivenditori di mobili come IKEA , Houzz e Wayfair . Questi rivenditori offrono app che consentono ai consumatori di visualizzare i propri prodotti a casa prima di acquistare qualsiasi cosa. Nel 2017, Ikea ha annunciato l'app Ikea Place. Contiene un catalogo di oltre 2.000 prodotti, quasi la collezione completa dell'azienda di divani, poltrone, tavolini e contenitori che si possono posizionare ovunque in una stanza con il proprio telefono. L'app ha permesso di avere modelli 3D e realistici di mobili nello spazio abitativo del cliente. IKEA si è resa conto che i suoi clienti non fanno più acquisti nei negozi così spesso o non effettuano più acquisti diretti. L'acquisizione di Primer da parte di Shopify, un'app AR mira a spingere i venditori di piccole e medie dimensioni verso lo shopping AR interattivo con un'integrazione AR facile da usare e un'esperienza utente sia per i commercianti che per i consumatori.

Letteratura

La prima descrizione dell'AR come è conosciuta oggi è stata in Virtual Light , il romanzo del 1994 di William Gibson. Nel 2011, AR è stata miscelata con la poesia di ni ka della Sekai Camera di Tokyo, in Giappone. La prosa di queste poesie AR proviene da Paul Celan , Die Niemandsrose , che esprime le conseguenze del terremoto e dello tsunami del Tōhoku del 2011 .

Arte visiva

L'AR applicata nelle arti visive consente a oggetti o luoghi di innescare esperienze artistiche multidimensionali e interpretazioni della realtà.

La realtà aumentata può aiutare nella progressione dell'arte visiva nei musei consentendo ai visitatori dei musei di visualizzare le opere d'arte nelle gallerie in modo multidimensionale attraverso gli schermi del telefono. Il Museum of Modern Art di New York ha creato una mostra nel suo museo d'arte che mostra le funzionalità AR che gli spettatori possono vedere utilizzando un'app sul proprio smartphone. Il museo ha sviluppato la propria app personale, denominata MoMAR Gallery, che gli ospiti del museo possono scaricare e utilizzare nella galleria specializzata in realtà aumentata per visualizzare in modo diverso i dipinti del museo. Ciò consente alle persone di vedere aspetti nascosti e informazioni sui dipinti e di essere in grado di avere un'esperienza tecnologica interattiva anche con le opere d'arte.

La tecnologia AR è stata utilizzata anche in "Margin of Error" e "Revolutions" di Nancy Baker Cahill , le due opere d'arte pubblica che ha creato per la mostra Desert X del 2019 .

La tecnologia AR ha aiutato lo sviluppo della tecnologia di tracciamento oculare per tradurre i movimenti oculari di una persona disabile in disegni su uno schermo.

La tecnologia AR può essere utilizzata anche per posizionare oggetti nell'ambiente dell'utente. Un artista danese, Olafur Eliasson , sta posizionando oggetti come soli ardenti, rocce extraterrestri e animali rari nell'ambiente dell'utente.

Fitness

L'hardware e il software AR per l'uso nel fitness includono occhiali intelligenti realizzati per la bicicletta e la corsa, con analisi delle prestazioni e navigazione della mappa proiettata sul campo visivo dell'utente e boxe, arti marziali e tennis, in cui gli utenti rimangono consapevoli del loro ambiente fisico per la sicurezza . I giochi e i software relativi al fitness includono Pokemon Go e Jurassic World Alive .

Interazione umano-computer

Human Computer Interaction è un'area interdisciplinare dell'informatica che si occupa della progettazione e dell'implementazione di sistemi che interagiscono con le persone. I ricercatori in HCI provengono da una serie di discipline, tra cui informatica, ingegneria, design, fattore umano e scienze sociali, con l'obiettivo condiviso di risolvere i problemi nella progettazione e nell'uso della tecnologia in modo che possa essere utilizzata più facilmente ed efficacemente , in modo efficiente, sicuro e con soddisfazione.

Collaborazione remota

I bambini della scuola primaria imparano facilmente dalle esperienze interattive. Ad esempio, le costellazioni astronomiche e i movimenti degli oggetti nel sistema solare sono stati orientati in 3D e sovrapposti nella direzione in cui è stato tenuto il dispositivo, e ampliati con informazioni video supplementari. Le illustrazioni di libri di scienze cartacee potrebbero sembrare prendere vita come video senza richiedere al bambino di navigare verso materiali basati sul web.

Nel 2013 è stato lanciato su Kickstarter un progetto per insegnare l'elettronica con un giocattolo educativo che permetteva ai bambini di scansionare il loro circuito con un iPad e vedere la corrente elettrica che scorreva intorno. Sebbene alcune app educative fossero disponibili per l'AR entro il 2016, non erano ampiamente utilizzate. Le app che sfruttano la realtà aumentata per aiutare l'apprendimento includono SkyView per lo studio dell'astronomia, AR Circuits per la costruzione di semplici circuiti elettrici e SketchAr per il disegno.

L'AR sarebbe anche un modo per genitori e insegnanti di raggiungere i loro obiettivi per l'istruzione moderna, che potrebbe includere fornire un apprendimento più individualizzato e flessibile, stabilire connessioni più strette tra ciò che viene insegnato a scuola e il mondo reale e aiutare gli studenti a diventare più coinvolti in il proprio apprendimento.

Gestione delle emergenze/ricerca e soccorso

I sistemi di realtà aumentata sono utilizzati in situazioni di sicurezza pubblica , dalle super tempeste ai sospetti in generale.

Già nel 2009, due articoli di Emergency Management hanno discusso della tecnologia AR per la gestione delle emergenze. Il primo è stato "Augmented Reality—Emerging Technology for Emergency Management", di Gerald Baron. Secondo Adam Crow, "Tecnologie come la realtà aumentata (es: Google Glass) e le crescenti aspettative del pubblico continueranno a costringere i gestori delle emergenze professionali a cambiare radicalmente quando, dove e come la tecnologia viene implementata prima, durante e dopo i disastri ."

Un altro primo esempio è stato un aereo da ricerca alla ricerca di un escursionista disperso in un terreno accidentato di montagna. I sistemi di realtà aumentata hanno fornito agli operatori di telecamere aeree una consapevolezza geografica dei nomi e delle posizioni delle strade forestali combinata con il video della telecamera. L'operatore della telecamera è stato in grado di cercare meglio l'escursionista conoscendo il contesto geografico dell'immagine della telecamera. Una volta individuato, l'operatore ha potuto indirizzare in modo più efficiente i soccorritori verso la posizione dell'escursionista perché la posizione geografica e i punti di riferimento di riferimento erano chiaramente etichettati.

Interazione sociale

L'AR può essere utilizzato per facilitare l'interazione sociale. Un framework di social network in realtà aumentata chiamato Talk2Me consente alle persone di diffondere informazioni e visualizzare le informazioni pubblicizzate di altri in un modo di realtà aumentata. Le funzionalità di condivisione e visualizzazione delle informazioni tempestive e dinamiche di Talk2Me aiutano ad avviare conversazioni e fare amicizia per gli utenti con persone nelle vicinanze. Tuttavia, l'uso di un auricolare AR può inibire la qualità di un'interazione tra due persone se una non ne indossa uno se l'auricolare diventa una distrazione.

La realtà aumentata offre inoltre agli utenti la possibilità di praticare diverse forme di interazione sociale con altre persone in un ambiente sicuro e privo di rischi. Hannes Kauffman, Professore Associato di Realtà Virtuale presso TU Vienna , afferma: "Nella realtà aumentata collaborativa più utenti possono accedere a uno spazio condiviso popolato da oggetti virtuali, pur rimanendo radicati nel mondo reale. Questa tecnica è particolarmente potente per scopi didattici quando gli utenti sono collocato e può utilizzare mezzi di comunicazione naturali (discorso, gesti, ecc.), ma può anche essere miscelato con successo con la realtà virtuale immersiva o la collaborazione remota." Hannes cita l' istruzione come un potenziale utilizzo di questa tecnologia.

Videogiochi

L'industria dei giochi ha abbracciato la tecnologia AR. Sono stati sviluppati numerosi giochi per ambienti interni preparati, come l'air hockey AR, Titans of Space , il combattimento collaborativo contro i nemici virtuali e i giochi da tavolo da biliardo con AR potenziato.

La realtà aumentata ha permesso ai giocatori di videogiochi di sperimentare il gioco digitale in un ambiente reale. Niantic ha rilasciato il gioco mobile in realtà aumentata Pokémon Go . Disney ha collaborato con Lenovo per creare il gioco di realtà aumentata Star Wars : Jedi Challenges che funziona con un visore Lenovo Mirage AR, un sensore di tracciamento e un controller Lightsaber , il cui lancio è previsto per dicembre 2017.

I giochi in realtà aumentata (ARG) vengono utilizzati anche per commercializzare proprietà di intrattenimento cinematografico e televisivo. Il 16 marzo 2011, BitTorrent ha promosso una versione con licenza aperta del lungometraggio Zenith negli Stati Uniti. Gli utenti che hanno scaricato il software client BitTorrent sono stati anche incoraggiati a scaricare e condividere la prima parte delle tre parti del film. Il 4 maggio 2011, la seconda parte del film è stata resa disponibile su VODO . L'uscita a episodi del film, integrata da una campagna di marketing transmediale ARG, ha creato un effetto virale e oltre un milione di utenti ha scaricato il film.

Design industriale

L'AR consente ai progettisti industriali di sperimentare la progettazione e il funzionamento di un prodotto prima del completamento. Volkswagen ha utilizzato l'AR per confrontare le immagini dei crash test calcolate e quelle effettive. L'AR è stato utilizzato per visualizzare e modificare la struttura della carrozzeria e il layout del motore. È stato anche utilizzato per confrontare i modelli digitali con i modelli fisici per trovare discrepanze tra loro.

Pianificazione, pratica e formazione sanitaria

Una delle prime applicazioni della realtà aumentata è stata nel settore sanitario, in particolare per supportare la pianificazione, la pratica e la formazione delle procedure chirurgiche. Già nel 1992, il miglioramento delle prestazioni umane durante l'intervento chirurgico era un obiettivo formalmente dichiarato durante la costruzione dei primi sistemi di realtà aumentata nei laboratori dell'aeronautica statunitense. Dal 2005, per localizzare le vene è stato utilizzato un dispositivo chiamato cercatore di vene nel vicino infrarosso che filma le vene sottocutanee, elabora e proietta l'immagine delle vene sulla pelle. L'AR fornisce ai chirurghi i dati di monitoraggio del paziente nello stile del display heads-up di un pilota di caccia e consente di accedere e sovrapporre i record di imaging del paziente, inclusi i video funzionali. Gli esempi includono una vista virtuale a raggi X basata su una tomografia precedente o su immagini in tempo reale da sonde a ultrasuoni e microscopia confocale , visualizzazione della posizione di un tumore nel video di un endoscopio o rischi di esposizione alle radiazioni da dispositivi di imaging a raggi X. L'AR può migliorare la visualizzazione di un feto all'interno dell'utero materno . Siemens, Karl Storz e IRCAD hanno sviluppato un sistema per la chirurgia epatica laparoscopica che utilizza l'AR per visualizzare tumori e vasi sotto la superficie. AR è stato utilizzato per il trattamento della fobia degli scarafaggi. Ai pazienti che indossano occhiali per realtà aumentata può essere ricordato di assumere farmaci. La realtà aumentata può essere molto utile in campo medico. Potrebbe essere utilizzato per fornire informazioni cruciali a un medico o un chirurgo senza che distolgano gli occhi dal paziente. Il 30 aprile 2015 Microsoft ha annunciato Microsoft HoloLens , il loro primo tentativo di realtà aumentata. HoloLens ha fatto progressi nel corso degli anni ed è in grado di proiettare ologrammi per la chirurgia guidata dalle immagini basata sulla fluorescenza nel vicino infrarosso. Con l'avanzare della realtà aumentata, trova sempre più applicazioni nel settore sanitario. La realtà aumentata e simili utilità basate su computer vengono utilizzate per formare professionisti del settore medico. In ambito sanitario, l'AR può essere utilizzato per fornire una guida durante gli interventi diagnostici e terapeutici, ad esempio durante gli interventi chirurgici. Magee et al. ad esempio descrivere l'uso della realtà aumentata per la formazione medica nella simulazione del posizionamento dell'ago guidato dagli ultrasuoni. Uno studio molto recente di Akçayır, Akçayır, Pektaş e Ocak (2016) ha rivelato che la tecnologia AR migliora le capacità di laboratorio degli studenti universitari e li aiuta a sviluppare atteggiamenti positivi relativi al lavoro di laboratorio di fisica. Recentemente, la realtà aumentata ha iniziato a vedere l'adozione in neurochirurgia , un campo che richiede grandi quantità di immagini prima delle procedure.

Immersione spaziale e interazione

Le applicazioni di realtà aumentata, in esecuzione su dispositivi palmari utilizzati come cuffie per realtà virtuale, possono anche digitalizzare la presenza umana nello spazio e fornire un modello generato dal computer, in uno spazio virtuale in cui possono interagire ed eseguire varie azioni. Tali capacità sono dimostrate da Project Anywhere, sviluppato da uno studente post-laurea all'ETH di Zurigo, che è stato soprannominato "un'esperienza fuori dal corpo".

Addestramento al volo

Basandosi su decenni di ricerca percettivo-motoria in psicologia sperimentale, i ricercatori dell'Aviation Research Laboratory dell'Università dell'Illinois a Urbana-Champaign hanno utilizzato la realtà aumentata sotto forma di una traiettoria di volo nel cielo per insegnare agli studenti di volo come far atterrare un aeroplano usando un simulatore di volo Un programma adattivo aumentato in cui agli studenti è stato mostrato l'aumento solo quando sono partiti dalla traiettoria di volo si è rivelato un intervento formativo più efficace di un programma costante. Gli studenti di volo hanno insegnato ad atterrare nel simulatore con il potenziamento adattivo hanno imparato ad atterrare con un aereo leggero più rapidamente rispetto agli studenti con la stessa quantità di addestramento di atterraggio nel simulatore ma con potenziamento costante o senza alcun potenziamento.

Militare

Un'interessante applicazione iniziale dell'AR si è verificata quando Rockwell International ha creato sovrapposizioni di mappe video di tracce di detriti satellitari e orbitali per aiutare nelle osservazioni spaziali presso l'Air Force Maui Optical System. Nel loro articolo del 1993 "Debris Correlation Using the Rockwell WorldView System" gli autori descrivono l'uso di mappe sovrapposte applicate ai video dei telescopi di sorveglianza spaziale. Le sovrapposizioni della mappa indicavano le traiettorie di vari oggetti in coordinate geografiche. Ciò ha permesso agli operatori del telescopio di identificare i satelliti e anche di identificare e catalogare detriti spaziali potenzialmente pericolosi.

A partire dal 2003 l'esercito degli Stati Uniti ha integrato il sistema di realtà aumentata SmartCam3D nello Shadow Unmanned Aerial System per aiutare gli operatori di sensori che utilizzano telecamere telescopiche per individuare persone o punti di interesse. Il sistema combinava informazioni geografiche fisse, inclusi nomi di strade, punti di interesse, aeroporti e ferrovie, con video in diretta dal sistema di telecamere. Il sistema ha offerto una modalità "immagine nell'immagine" che gli consente di mostrare una visione sintetica dell'area circostante il campo visivo della telecamera. Questo aiuta a risolvere un problema in cui il campo visivo è così ristretto da escludere un contesto importante, come se "guardasse attraverso una cannuccia di soda". Il sistema mostra indicatori di posizione di amici/nemici/neutri in tempo reale combinati con video in diretta, fornendo all'operatore una migliore consapevolezza della situazione.

A partire dal 2010, i ricercatori coreani stanno cercando di implementare i robot di rilevamento delle mine nelle forze armate. Il progetto proposto per un tale robot include una piattaforma mobile che è come un binario che sarebbe in grado di coprire distanze irregolari comprese le scale. Il sensore di rilevamento delle mine del robot includerebbe una combinazione di metal detector e radar a penetrazione del suolo per individuare mine o IED . Questo design unico sarebbe incommensurabilmente utile per salvare la vita dei soldati coreani.

I ricercatori dell'USAF Research Lab (Calhoun, Draper et al.) hanno riscontrato un aumento di circa due volte della velocità con cui gli operatori di sensori UAV hanno trovato punti di interesse utilizzando questa tecnologia. Questa capacità di mantenere la consapevolezza geografica aumenta quantitativamente l'efficienza della missione. Il sistema è in uso sull'esercito americano RQ-7 Shadow e sui sistemi aerei senza pilota MQ-1C Grey Eagle.

In combattimento, l'AR può fungere da sistema di comunicazione in rete che trasmette dati utili sul campo di battaglia sugli occhiali di un soldato in tempo reale. Dal punto di vista del soldato, persone e vari oggetti possono essere contrassegnati con indicatori speciali per avvertire di potenziali pericoli. È inoltre possibile eseguire il rendering di mappe virtuali e immagini della telecamera a 360 ° per aiutare la navigazione di un soldato e la prospettiva del campo di battaglia, e questo può essere trasmesso ai leader militari in un centro di comando remoto. La combinazione di visualizzazione delle telecamere a 360° e AR può essere utilizzata a bordo di veicoli da combattimento e carri armati come sistema di revisione circolare .

L'AR può essere molto efficace per progettare virtualmente le topologie 3D dei depositi di munizioni nel terreno con la scelta della combinazione di munizioni in pile e le distanze tra loro con una visualizzazione delle aree a rischio. L'ambito delle applicazioni AR include anche la visualizzazione dei dati dai sensori di monitoraggio delle munizioni incorporati.

L' X-38 della NASA è stato pilotato utilizzando un sistema di visione sintetica ibrido che ha sovrapposto i dati della mappa al video per fornire una navigazione avanzata per il veicolo spaziale durante i test di volo dal 1998 al 2002. Ha utilizzato il software LandForm che è stato utile per periodi di visibilità limitata, incluso un esempio quando la finestra della videocamera si è ghiacciata lasciando gli astronauti a fare affidamento sulle sovrapposizioni della mappa. Il software LandForm è stato anche testato in volo presso l'Army Yuma Proving Ground nel 1999. Nella foto a destra si possono vedere gli indicatori della mappa che indicano le piste, la torre di controllo del traffico aereo, le vie di rullaggio e gli hangar sovrapposti al video.

L'AR può aumentare l'efficacia dei dispositivi di navigazione. Le informazioni possono essere visualizzate sul parabrezza di un'automobile indicando le direzioni di destinazione e il contatore, il tempo, il terreno, le condizioni stradali e le informazioni sul traffico, nonché gli avvisi sui potenziali pericoli sul loro percorso. Dal 2012, una società con sede in Svizzera WayRay ha sviluppato sistemi di navigazione AR olografici che utilizzano elementi ottici olografici per proiettare tutte le informazioni relative al percorso, comprese indicazioni stradali , notifiche importanti e punti di interesse, direttamente nella linea di vista dei conducenti e molto più avanti di il veicolo. A bordo delle navi marittime, l'AR può consentire agli osservatori del ponte di monitorare continuamente informazioni importanti come la rotta e la velocità di una nave mentre si spostano sul ponte o svolgono altre attività.

Posto di lavoro

La realtà aumentata può avere un impatto positivo sulla collaborazione lavorativa poiché le persone possono essere inclini a interagire più attivamente con il loro ambiente di apprendimento. Può anche incoraggiare il tacito rinnovamento della conoscenza che rende le imprese più competitive. AR è stato utilizzato per facilitare la collaborazione tra i membri del team distribuiti tramite conferenze con partecipanti locali e virtuali. Le attività AR includevano brainstorming e riunioni di discussione utilizzando la visualizzazione comune tramite tavoli touch screen, lavagne digitali interattive, spazi di progettazione condivisi e sale di controllo distribuite.

Negli ambienti industriali, la realtà aumentata sta dimostrando di avere un impatto sostanziale con sempre più casi d'uso che emergono in tutti gli aspetti del ciclo di vita del prodotto, a partire dalla progettazione del prodotto e l'introduzione di nuovi prodotti (NPI) alla produzione, all'assistenza e alla manutenzione, alla movimentazione dei materiali e distribuzione. Ad esempio, sono state visualizzate etichette su parti di un sistema per chiarire le istruzioni operative per un meccanico che esegue la manutenzione su un sistema. Le linee di assemblaggio hanno beneficiato dell'utilizzo di AR. Oltre a Boeing, BMW e Volkswagen erano note per aver incorporato questa tecnologia nelle linee di assemblaggio per monitorare i miglioramenti dei processi. Le grandi macchine sono difficili da mantenere a causa dei loro molteplici strati o strutture. L'AR consente alle persone di guardare attraverso la macchina come con una radiografia, indicando subito il problema.

Con l'evoluzione della tecnologia AR e l'arrivo sul mercato di dispositivi AR di seconda e terza generazione, l'impatto dell'AR nelle aziende continua a crescere. Nella Harvard Business Review , Magid Abraham e Marco Annunziata discutono di come i dispositivi AR vengano ora utilizzati per "aumentare la produttività dei lavoratori su una serie di attività la prima volta che vengono utilizzati, anche senza una formazione precedente". Sostengono che "queste tecnologie aumentare la produttività rendendo i lavoratori più qualificati ed efficienti, e quindi avere il potenziale per produrre sia una maggiore crescita economica che posti di lavoro migliori".

Trasmissione ed eventi dal vivo

Le visualizzazioni meteorologiche sono state la prima applicazione della realtà aumentata in televisione. Ora è diventato comune nel casting meteorologico visualizzare video in full motion di immagini catturate in tempo reale da più telecamere e altri dispositivi di imaging. Abbinate a simboli grafici 3D e mappate su un modello geospaziale virtuale comune, queste visualizzazioni animate costituiscono la prima vera applicazione dell'AR alla TV.

L'AR è diventato comune nelle trasmissioni televisive sportive. I luoghi di sport e intrattenimento sono dotati di aumento della trasparenza e della sovrapposizione tramite feed di telecamere tracciate per una migliore visualizzazione da parte del pubblico. Gli esempi includono la linea gialla " first down " vista nelle trasmissioni televisive delle partite di football americano che mostra la linea che la squadra in attacco deve attraversare per ricevere un primo down. L'AR viene anche utilizzato in associazione con eventi calcistici e altri eventi sportivi per mostrare pubblicità commerciali sovrapposte alla vista dell'area di gioco. Sezioni di campi da rugby e da cricket mostrano anche immagini sponsorizzate. Le trasmissioni televisive di nuoto spesso aggiungono una linea attraverso le corsie per indicare la posizione dell'attuale detentore del record mentre una gara procede per consentire agli spettatori di confrontare la gara attuale con la migliore prestazione. Altri esempi includono il monitoraggio del disco da hockey e le annotazioni delle prestazioni delle auto da corsa e le traiettorie della palla da biliardo.

L'AR è stato utilizzato per migliorare le performance di concerti e teatro. Ad esempio, gli artisti consentono agli ascoltatori di aumentare la propria esperienza di ascolto aggiungendo la propria performance a quella di altre band/gruppi di utenti.

Turismo e visite turistiche

I viaggiatori possono utilizzare l'AR per accedere a display informativi in tempo reale relativi a una posizione, alle sue caratteristiche e ai commenti o ai contenuti forniti dai visitatori precedenti. Le applicazioni AR avanzate includono simulazioni di eventi storici, luoghi e oggetti resi nel paesaggio.

Le applicazioni AR collegate a posizioni geografiche presentano le informazioni sulla posizione tramite audio, annunciando le caratteristiche di interesse in un particolare sito non appena diventano visibili all'utente.

Traduzione

I sistemi AR come Word Lens possono interpretare il testo straniero su cartelli e menu e, nella vista aumentata dell'utente, rivisualizzare il testo nella lingua dell'utente. Le parole pronunciate di una lingua straniera possono essere tradotte e visualizzate nella vista dell'utente come sottotitoli stampati.

Musica

È stato suggerito che la realtà aumentata possa essere utilizzata in nuovi metodi di produzione musicale , mixaggio , controllo e visualizzazione .

È stato concettualizzato uno strumento per la creazione di musica 3D nei club che, oltre alle normali funzioni di mixaggio del suono, consente al DJ di riprodurre decine di campioni sonori , posizionati ovunque nello spazio 3D.

I team del Leeds College of Music hanno sviluppato un'app AR che può essere utilizzata con i banchi Audient e consentire agli studenti di utilizzare il proprio smartphone o tablet per mettere strati di informazioni o interattività sopra un banco di missaggio Audient.

ARmony è un pacchetto software che utilizza la realtà aumentata per aiutare le persone a imparare uno strumento.

In un progetto proof-of-concept Ian Sterling, uno studente di interaction design presso il California College of the Arts , e l'ingegnere software Swaroop Pal hanno dimostrato un'app HoloLens il cui scopo principale è fornire un'interfaccia utente spaziale 3D per dispositivi multipiattaforma: Android Music Player e Fan and Light controllati da Arduino e consentono anche l'interazione utilizzando lo sguardo e il controllo dei gesti.

AR Mixer è un'app che consente di selezionare e mixare i brani manipolando gli oggetti, ad esempio cambiando l'orientamento di una bottiglia o di una lattina.

In un video, Uriel Yehezkel dimostra l'utilizzo del controller Leap Motion e GECO MIDI per controllare Ableton Live con i gesti delle mani e afferma che con questo metodo è stato in grado di controllare più di 10 parametri contemporaneamente con entrambe le mani e di assumere il pieno controllo sulla costruzione del canto, emozione ed energia.

È stato proposto un nuovo strumento musicale che consente ai principianti di suonare composizioni musicali elettroniche, remixando e modulando in modo interattivo i loro elementi, manipolando semplici oggetti fisici.

È stato suggerito un sistema che utilizza gesti espliciti e mosse di danza implicite per controllare i potenziamenti visivi di una performance di musica dal vivo che consentono esibizioni più dinamiche e spontanee e, in combinazione con la realtà aumentata indiretta, portando a un'interazione più intensa tra artista e pubblico.

La ricerca dei membri del CRIStAL dell'Università di Lille utilizza la realtà aumentata per arricchire le prestazioni musicali. Il progetto ControllAR consente ai musicisti di aumentare le loro superfici di controllo MIDI con le interfacce utente grafiche remixate del software musicale . Il progetto Rouages propone di aumentare gli strumenti musicali digitali per rivelare i loro meccanismi al pubblico e quindi migliorare la vitalità percepita. Reflets è un nuovo display in realtà aumentata dedicato alle performance musicali in cui il pubblico agisce come un display 3D rivelando contenuti virtuali sul palco, che possono essere utilizzati anche per l'interazione e la collaborazione musicale 3D.

Snapchat

Gli utenti di Snapchat hanno accesso alla realtà aumentata nell'app di messaggistica istantanea dell'azienda attraverso l'uso dei filtri della fotocamera. A settembre 2017, Snapchat ha aggiornato la sua app per includere un filtro della fotocamera che consentiva agli utenti di eseguire il rendering di una versione animata di se stessi in un cartone animato chiamata " Bitmoji ". Questi avatar animati verrebbero proiettati nel mondo reale attraverso la fotocamera e possono essere fotografati o registrati video. Nello stesso mese, Snapchat ha anche annunciato una nuova funzionalità chiamata "Filtri Sky" che sarà disponibile sulla sua app. Questa nuova funzionalità utilizza la realtà aumentata per modificare l'aspetto di una foto scattata al cielo, proprio come gli utenti possono applicare i filtri dell'app ad altre immagini. Gli utenti possono scegliere tra filtri del cielo come notte stellata, nuvole tempestose, splendidi tramonti e arcobaleno.

I pericoli di AR

Modifiche alla realtà

In un articolo intitolato "Death by Pokémon GO" , i ricercatori della Krannert School of Management della Purdue University affermano che il gioco ha causato "un aumento sproporzionato degli incidenti veicolari e dei danni veicolari associati, lesioni personali e decessi nelle vicinanze di luoghi, chiamati PokéStop, dove gli utenti possono giocare durante la guida." Utilizzando i dati di un comune, il documento estrapola ciò che potrebbe significare a livello nazionale e ha concluso che "l'aumento degli incidenti attribuibile all'introduzione di Pokémon GO è di 145.632 con un aumento associato del numero di feriti di 29.370 e un aumento associato del numero di morti. di 256 nel periodo dal 6 luglio 2016 al 30 novembre 2016». Gli autori hanno estrapolato il costo di quegli incidenti e decessi tra $ 2 miliardi e $ 7,3 miliardi per lo stesso periodo. Inoltre, più di un utente Internet avanzato su tre intervistato vorrebbe eliminare gli elementi di disturbo intorno a sé, come spazzatura o graffiti. Vorrebbero persino modificare l'ambiente circostante cancellando i segnali stradali, i cartelloni pubblicitari e le vetrine poco interessanti. Quindi sembra che l'AR sia tanto una minaccia per le aziende quanto un'opportunità. Sebbene questo possa essere un incubo per numerosi marchi che non riescono a catturare l'immaginazione dei consumatori, crea anche il rischio che i portatori di occhiali per la realtà aumentata possano diventare inconsapevoli dei pericoli circostanti. I consumatori desiderano utilizzare gli occhiali per la realtà aumentata per trasformare l'ambiente circostante in qualcosa che rifletta le proprie opinioni personali. Circa due su cinque vogliono cambiare l'aspetto dell'ambiente circostante e persino il modo in cui le persone appaiono loro.

Successivamente, ai possibili problemi di privacy descritti di seguito, i problemi di sovraccarico e di dipendenza eccessiva sono il più grande pericolo di AR. Per lo sviluppo di nuovi prodotti relativi all'AR, ciò implica che l'interfaccia utente dovrebbe seguire alcune linee guida per non sovraccaricare l'utente di informazioni, impedendo anche all'utente di fare eccessivo affidamento sul sistema AR in modo tale che importanti segnali dall'ambiente siano perse. Questa è chiamata la chiave virtualmente aumentata. Una volta che la chiave viene ignorata, le persone potrebbero non desiderare più il mondo reale.

Preoccupazioni relative alla privacy

Il concetto di realtà aumentata moderna dipende dalla capacità del dispositivo di registrare e analizzare l'ambiente in tempo reale. Per questo motivo, ci sono potenziali preoccupazioni legali sulla privacy. Mentre il Primo Emendamento alla Costituzione degli Stati Uniti consente tale registrazione in nome dell'interesse pubblico, la registrazione costante di un dispositivo AR rende difficile farlo senza registrare anche al di fuori del pubblico dominio. Si potrebbero riscontrare complicazioni legali in aree in cui è previsto il diritto a una certa quantità di privacy o in cui vengono visualizzati supporti protetti da copyright.

In termini di privacy individuale, esiste la facilità di accesso alle informazioni che non si dovrebbe possedere prontamente su una data persona. Ciò si ottiene attraverso la tecnologia di riconoscimento facciale. Supponendo che l'AR passi automaticamente le informazioni sulle persone che l'utente vede, potrebbe esserci qualsiasi cosa vista dai social media, dalla fedina penale e dallo stato civile.

Il Codice etico sull'incremento umano, originariamente introdotto da Steve Mann nel 2004 e ulteriormente perfezionato con Ray Kurzweil e Marvin Minsky nel 2013, è stato infine ratificato alla conferenza di Virtual Reality Toronto il 25 giugno 2017.

Ricercatori notevoli

- Ivan Sutherland ha inventato il primo display VR montato sulla testa all'Università di Harvard .

- Steve Mann ha formulato un precedente concetto di realtà mediata negli anni '70 e '80, utilizzando fotocamere, processori e sistemi di visualizzazione per modificare la realtà visiva per aiutare le persone a vedere meglio (gestione della gamma dinamica), costruendo caschi per saldatura computerizzati e "realtà aumentata" sistemi di visione da utilizzare nella vita di tutti i giorni. È anche consigliere di Meta .

- Louis Rosenberg ha sviluppato uno dei primi sistemi AR conosciuti, chiamato Virtual Fixtures , mentre lavorava presso gli Armstrong Labs dell'aeronautica americana nel 1991, e ha pubblicato il primo studio su come un sistema AR può migliorare le prestazioni umane. Il successivo lavoro di Rosenberg alla Stanford University nei primi anni '90, è stata la prima prova che gli overlay virtuali, quando registrati e presentati sulla visione diretta di un utente del mondo fisico reale, potrebbero migliorare significativamente le prestazioni umane.

- Mike Abernathy ha aperto la strada a uno dei primi overlay video aumentati di successo (chiamato anche visione sintetica ibrida) utilizzando i dati delle mappe per i detriti spaziali nel 1993, mentre era alla Rockwell International. Ha co-fondato Rapid Imaging Software, Inc. ed è stato l'autore principale del sistema LandForm nel 1995 e del sistema SmartCam3D. La realtà aumentata LandForm è stata testata con successo in volo nel 1999 a bordo di un elicottero e SmartCam3D è stato utilizzato per pilotare l'X-38 della NASA dal 1999 al 2002. Lui e il collega della NASA Francisco Delgado hanno ricevuto i premi Top5 della National Defense Industries Association nel 2004.

- Steven Feiner, professore alla Columbia University , è l'autore di un articolo del 1993 su un prototipo di sistema AR, KARMA (l'assistente per la manutenzione della realtà aumentata basato sulla conoscenza), insieme a Blair MacIntyre e Doree Seligmann. È anche consigliere di Meta .

- S. Ravela , B. Draper, J. Lim e A. Hanson hanno sviluppato un sistema di realtà aumentata senza marcatori/apparecchi con visione artificiale nel 1994. Hanno aumentato un blocco motore osservato da una singola videocamera con annotazioni per la riparazione. Usano la stima della posa basata sul modello , i grafici degli aspetti e il tracciamento delle caratteristiche visive per registrare dinamicamente il modello con il video osservato.

- Ronald Azuma è uno scienziato e autore di importanti lavori in AR, tra cui A survey of Auged Reality , l'articolo più citato nel campo dell'AR e uno dei più influenti giornali del MIT Press di tutti i tempi.

- Francisco Delgado è un ingegnere e project manager della NASA specializzato in ricerca e sviluppo di interfacce umane. A partire dal 1998 ha condotto ricerche su display che combinassero video con sistemi di visione sintetica (chiamati all'epoca visione sintetica ibrida) che oggi riconosciamo come sistemi di realtà aumentata per il controllo di aerei e veicoli spaziali. Nel 1999 lui e il collega Mike Abernathy hanno testato in volo il sistema LandForm a bordo di un elicottero dell'esercito americano. Delgado ha supervisionato l'integrazione dei sistemi LandForm e SmartCam3D nell'X-38 Crew Return Vehicle. Nel 2001, Aviation Week ha riportato l'uso riuscito da parte dell'astronauta della NASA della visione sintetica ibrida (realtà aumentata) per far volare l'X-38 durante un test di volo al Dryden Flight Research Center. La tecnologia è stata utilizzata in tutti i voli successivi dell'X-38. Delgado è stato co-destinatario del premio Top 5 software dell'anno della National Defense Industries Association 2004 per SmartCam3D.

- Bruce H. Thomas e Wayne Piekarski hanno sviluppato il sistema Tinmith nel 1998. Insieme a Steve Feiner con il suo sistema MARS sono stati i pionieri della realtà aumentata all'aperto.

- Mark Billinghurst è professore di interazione uomo-computer presso l' Università del South Australia e un notevole ricercatore di AR. Ha prodotto oltre 250 pubblicazioni tecniche e presentato dimostrazioni e corsi in un'ampia varietà di conferenze.

- Reinhold Behringer ha svolto importanti primi lavori (1998) sulla registrazione delle immagini per la realtà aumentata e prototipi di banchi di prova indossabili per la realtà aumentata. Ha anche co-organizzato il Primo Simposio Internazionale IEEE sulla Realtà Aumentata nel 1998 (IWAR'98) e ha co-curato uno dei primi libri sulla realtà aumentata.

- Felix G. Hamza-Lup, Larry Davis e Jannick Rolland hanno sviluppato il display 3D ARC con display ottico trasparente con avviso di testa per la visualizzazione AR nel 2002.

- Dieter Schmalstieg e Daniel Wagner hanno sviluppato un sistema di tracciamento dei marker per telefoni cellulari e PDA nel 2009.

- Tracy McSheery, di Phasespace, sviluppatrice nel 2009 di obiettivi AR ad ampio campo visivo utilizzati in Meta 2 e altri.

- Jeri Ellsworth ha diretto uno sforzo di ricerca per Valve sulla realtà aumentata (AR), portando poi quella ricerca alla sua start-up CastAR . L'azienda, fondata nel 2013, alla fine ha chiuso. Successivamente, ha creato un'altra start-up basata sulla stessa tecnologia chiamata Tilt Five; un'altra start-up AR formata da lei con lo scopo di creare un dispositivo per giochi da tavolo digitali .

- John Tinnell, Professore Associato presso l'Università di Denver, è l'autore di Actionable Media: Digital Communication Beyond the Desktop (2018) e co-editore (con Sean Morey, Professore Associato presso l'Università del Tennessee-Knoxville) di Augmented Reality: Innovative Perspectives Tra arte, industria e mondo accademico (2017). Entrambi i lavori esplorano le applicazioni della tecnologia AR alle discipline umanistiche come l'arte visiva, la storia e la scrittura pubblica/professionale.

Storia

- 1901: L. Frank Baum , un autore, menziona per la prima volta l'idea di un display/occhiali elettronici che sovrappongono i dati alla vita reale (in questo caso "persone"). Si chiama "marcatore di caratteri".

- 1957-62: Morton Heilig , un direttore della fotografia, crea e brevetta un simulatore chiamato Sensorama con immagini, suoni, vibrazioni e odori.